语言是人类沟通的基石。一个婴儿如何从简单的咿呀声发展到流畅的语言表达,这一过程一直是心理学、语言学和人工智能领域研究的焦点。

过去,研究者主要依靠观察和假设来探索婴儿是如何学习语言的。

一项发表在《科学》杂志上的研究通过分析婴儿的视频数据,训练了一套AI系统,模拟婴儿学习语言的过程。

这一研究不仅为我们理解语言的习得提供了新的视角,也为研究AI的自然语言处理能力提供了新的方法。

从婴儿的视角看世界

在这项研究中,科学家采取了一种创新的方法收集数据——记录一个婴儿从六个月大到两岁半的日常活动视频。

研究团队让婴儿每周佩戴头戴式摄像头约2小时,总计获得了61小时的视频资料。

佩戴摄像头的婴儿(图来源:纽约时报)

这些视频不仅捕捉到了婴儿的视觉体验,还记录了父母与婴儿之间的互动。

为了构建这个特殊的数据集,研究助理做了大量繁琐工作,他们对视频中的每一帧进行了细致的标注。

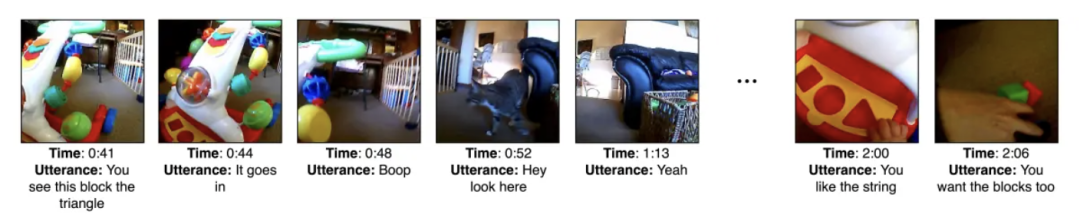

视频共有60万帧,这些标注涵盖了37500个发音,例如父母在婴儿玩耍时说的话:“你看到那个三角形的积木了吗?”

这为注释AI系统提供了丰富的学习材料,使其能够模拟婴儿如何通过视觉和听觉信息学习语言。

AI学习语言的过程

研究团队采用了一种先进的机器学习技术——对比学习,以及模拟人脑结构和功能的神经网络,来训练AI系统。

这种训练方式模仿了婴儿学习语言的过程,即通过不断试错,学习将声音与视觉信息相匹配。 通过训练,AI学会了将视频中的图像与对应的单词关联起来。

婴儿视角的视频帧及其附带的转录话语(Wai

Keen Vong 供图)

婴儿视角的视频帧及其附带的转录话语(Wai

Keen Vong 供图)

对比学习是一种强有力的学习技术,它通过比较不同数据点之间的关系来训练模型。在这项研究中,AI系统必须识别出哪些图像与相应的单词匹配,哪些不匹配。

这种学习方式与婴儿学习语言的过程非常相似。

AI的超预期表现

研究结果显示,AI系统在将图像与其正确的单词匹配方面的成功率达到了62%,远超科学家们预期的25%的随机成功率。

这一发现挑战了传统观念,即语言习得必须依赖于复杂的内在机制。

研究表明,即使是一个相对简单的AI系统,也能通过关联日常生活中的视觉和听觉信息来学习语言。

AI系统在识别高频出现的物体时表现更佳,如苹果和婴儿床,这可能是因为这些物体在婴儿的日常生活中出现频率较高。

然而,AI在识别刀子等物体时表现不佳,这可能是因为这些物体在婴儿的日常生活中出现得较少,或者是因为它们的图像在视频中不够清晰。

小 结

尽管当前的AI系统仍被视为“脆弱且缺乏常识”,但这项研究无疑为我们向未来迈出了一大步。

这项研究向我们展示了,AI可以通过类似婴儿的日常经验来学习单词,而不必依赖于庞大的数据集。 未来或许AI能够更自然地习得语言。

研究团队计划将更多的头戴式相机视频数据纳入他们的模型中,以观察AI系统在接收到更多数据时的学习成果。

他们还希望测试模型是否能够学习更复杂的单词和语言行为,这些行为往往在年龄更大时出现。

参考文献

Vong, W. K., et al. (2024). Supplementary Materials for “Grounded language acquisition through the eyes and ears of a single child.” Science, 383(504). https://doi.org/10.1126/science.adi1374

Sullivan, J., & Mei, M., et al. (2021). SAYCam: A Large, Longitudinal Audiovisual Dataset Recorded From the Infant’s Perspective. Open Mind: Discoveries in Cognitive Science, 5, 20–29. https://doi.org/10.1162/opmi_a_00039

https://www.nytimes.com/2024/04/30/science/ai-infants-language-learning.html

https://time.com/6632398/ai-language-study-baby/